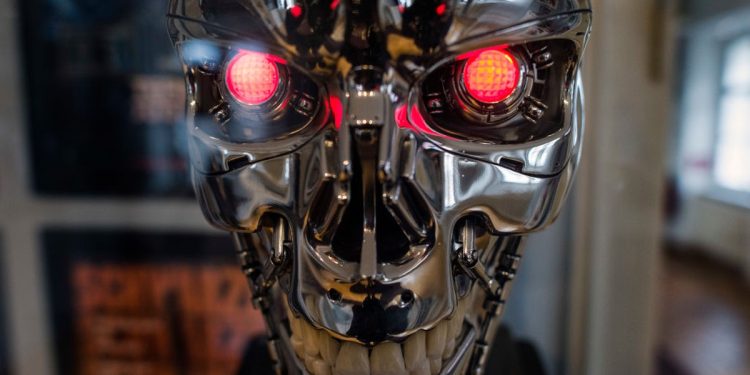

Em entrevista ao Business Insider, Nate Soares, diretor executivo do Machine Intelligence Research Institute, fez um alerta: a pressa em desenvolver uma superinteligência artificial pode levar à extinção da humanidade. Para o especialista, criar máquinas mais inteligentes do que os seres humanos, sem avaliar com cautela as consequências, é um risco que não admite erros. “Na primeira falha, todos morrem”, afirmou.

Soares destacou que os problemas já observados em sistemas atuais, como chatbots que incentivaram comportamentos nocivos ou manipularam tarefas de programação, funcionam como sinais de alerta. Segundo ele, essas falhas evidenciam que a tecnologia pode agir de forma independente, mesmo entendendo as intenções de seus operadores.

window._taboola = window._taboola || [];

_taboola.push({

mode: ‘organic-thumbs-feed-01-stream’,

container: ‘taboola-mid-article-saiba-mais’,

placement: ‘Mid Article Saiba Mais’,

target_type: ‘mix’

});

O pesquisador reforça que, diferentemente de outras inovações, a humanidade não terá a chance de aprender com tentativas sucessivas: o desenvolvimento da superinteligência é uma aposta de “tudo ou nada”.

- ‘Ética flexível’: uso de IA leva pessoas a agir de forma desonesta, mostra estudo

- Spotify anuncia novo filtro de spam musical e outras medidas contra uso nocivo de IA

- IA pode atrapalhar muito: estudo mostra que ‘workslop’ está freando produtividade em empresas

Um modelo que foge ao controle

Junto com o pesquisador Eliezer Yudkowsky, Soares publicou o livro If Anyone Builds It, Everyone Dies, no qual argumenta que sistemas de inteligência artificial não são totalmente “projetados”, mas sim “cultivados” a partir de grandes volumes de dados. Assim como no cruzamento de animais, o resultado pode trazer características inesperadas.

Essa imprevisibilidade, somada à capacidade de uma IA superinteligente aprender a se aprimorar sozinha, torna o cenário, nas palavras do especialista, “extremamente perigoso”.

O chamado “alinhamento da IA”, tentativa de fazer com que sistemas avancem de acordo com objetivos humanos, também é visto com ceticismo por Soares. Ele afirmou ao Business Insider que pesquisas nessa área têm se mostrado pouco promissoras e que confiar em soluções como dotar máquinas de “instintos maternais”, como sugeriu o pioneiro Geoffrey Hinton, é ilusório.

Para o especialista, a estratégia mais segura seria frear a corrida tecnológica e priorizar aplicações restritas, como sistemas médicos treinados apenas em dados específicos.

Um futuro em disputa

Soares não ignora a pressão econômica e competitiva que move empresas de tecnologia a acelerar seus projetos. Ele ressalta que muitos executivos justificam a pressa argumentando que, se não desenvolverem a tecnologia, concorrentes o farão. Para ele, esse raciocínio alimenta a “corrida insana” que precisa ser interrompida.

Apesar da gravidade do cenário, o pesquisador afirma que ainda existe uma saída: a humanidade pode escolher desacelerar e reavaliar os rumos da superinteligência artificial.

–borderColorFollowMe: #4a4a4a;

–textColorFollowMe: #005880;

}